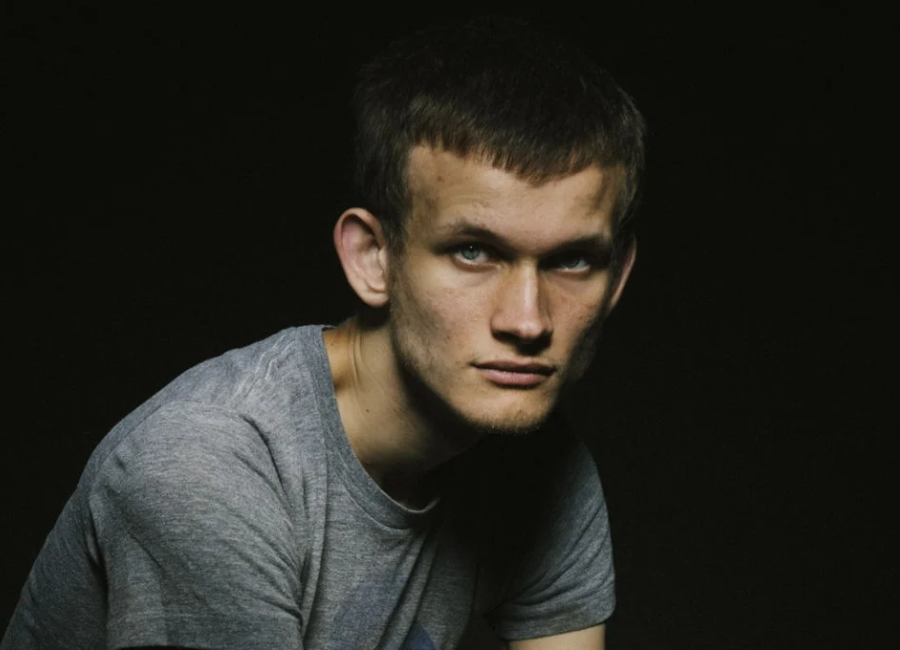

Vitalik Buterin, cofundador da Ethereum, destacou a necessidade de aplicar inteligência artificial (IA) para a verificação formal de código e detecção de bugs, consideradas as maiores fragilidades da plataforma.

“No momento, o maior risco técnico do Ethereum provavelmente são os bugs no código, e qualquer coisa que pudesse mudar significativamente o jogo seria incrível”, disse ele em um tweet publicado no domingo (18).

Embora Buterin defenda a aplicação da IA para a segurança do Ethereum, ele já expressou preocupações sobre o potencial da tecnologia para se tornar uma ameaça à humanidade. Em um blog publicado em novembro de 2023, ele alertou para o risco de uma IA superinteligente se voltar contra os humanos, levando à extinção da espécie.

“Mas uma IA superinteligente, se decidir virar-se contra nós, pode muito bem não deixar sobreviventes e acabar com a humanidade para sempre. Mesmo Marte pode não ser seguro”, falou Buterin na época.

Apesar das preocupações anteriores, Buterin demonstra otimismo em relação ao potencial da IA para contribuir para o desenvolvimento do Ethereum. Em um texto publicado em janeiro de 2024, ele afirmou que a IA pode se tornar um "jogador no jogo" nos mercados de criptomoedas.